Châu Âu bước vào thời đại mới của trí tuệ nhân tạo

Nghị viện châu Âu (EP) đã thông qua Đạo luật Trí tuệ Nhân tạo (AI Act), tạo ra một quy định đột phá đầu tiên trên thế giới nhằm điều chỉnh việc sử dụng trí tuệ nhân tạo như ChatGPT, được phân loại là "có nguy cơ cao". Cuộc chiến "ủng hộ sáng tạo" chống lại "ủng hộ quy định" đã nghiêng về lợi ích của nhóm thứ hai. Nhưng Ủy ban châu Âu (EC) hứa hẹn sẽ phát triển tốt hơn.

Dự thảo AI Act vừa vượt qua một bước tiến lịch sử hôm 13/3 tại Strasbourg. Các nghị sỹ châu Âu đã phê chuẩn với tỷ lệ đồng thuận rất cao cho văn bản sẽ đi vào lịch sử như là cơ sở pháp lý cho việc phát triển và thương mại sản phẩm sử dụng công nghệ trí tuệ nhân tạo. Phiên bản cuối cùng dự kiến sẽ được 27 quốc gia thành viên Liên minh châu Âu (EU) thông qua trong tháng Tư để có hiệu lực từ năm 2025.Một lần nữa, châu Âu lại đi tiên phong khi áp đặt quy định lớn thứ tư trong quá trình chuyển đổi kỹ thuật số, sau Quy định chung về bảo vệ dữ liệu (GDPR), Đạo luật Dịch vụ Kỹ thuật số và Đạo luật Thị trường Kỹ thuật số. Do đó, các công ty sẽ phải thích nghi với môi trường pháp lý mới.Uy tín của EC lại đặt ở việc tạo ra một "Hiệu ứng Brussels", một sự rung chuyển tích cực trên toàn bộ ngành công nghiệp, kể cả bên ngoài biên giới châu Âu. Đây sẽ là giá trị của sự tin tưởng vào công nghệ, thứ thường khiến người ta sợ hãi cũng như mê hoặc. Đồng thời cũng là niềm tin vào sự đổi mới. Và theo nghiên cứu của hãng McKinsey, doanh thu của một ngành có thể giúp kinh tế toàn cầu tăng thêm 4.400 tỷ USD.Ít nhất, đó là quan điểm được EC và Chính phủ Bỉ, quốc gia hiện đang giữ chức Chủ tịch Hội đồng EU, nỗ lực hết sức để thúc đẩy việc điều chỉnh, trước các quốc gia có thái độ cảnh giác hơn, như Pháp và Đức. Mục đích là để bảo vệ những "viên ngọc địa phương" của họ như Mistral AI và Aleph Alpha, được xem là những “tân binh” tiềm năng của châu Âu về trí tuệ nhân tạo.Để có thể hình dung về tốc độ thay đổi công nghệ, hai công ty khởi nghiệp này thậm chí còn chưa ra đời khi phiên bản đầu tiên của Đạo luật AI được trình bày, vào ngày 21/4/2021. Trong ba năm, đạo luật đã phải tích hợp cấp tốc “cơn sóng thần” trí tuệ tổng hợp được thể hiện bằng ChatGPT, có khả năng tạo ra văn bản bằng ngôn ngữ tự nhiên, mã lập trình, hình ảnh, video, âm nhạc, dựa trên yêu cầu do người dùng đưa ra.Sau gần ba năm đàm phán căng thẳng, được Mỹ theo dõi sát sao, thì AI Act đã trở thành một văn bản mà ngay cả các nhà lãnh đạo như Sam Altman (đồng sáng lập Open AI), Sundar Pichai (Google) hoặc Elon Musk cũng cho rằng là cần thiết.Văn bản bắt đầu từ đầu, tức là một định nghĩa về trí tuệ nhân tạo, công nghệ đã xuất hiện từ những năm 1950. Do đó, trí tuệ nhân tạo là "hệ thống dựa trên máy tính, với mục tiêu rõ ràng hoặc không rõ ràng, suy luận từ các dữ liệu đầu vào mà nó nhận được, cách tạo ra kết quả như dự đoán, nội dung, gợi ý hoặc quyết định có thể ảnh hưởng đến môi trường thực hoặc ảo".Tin cùng chuyên mục

-

![Thế giới thiệt hại dầu mỏ như thế nào sau 50 ngày xung đột Trung Đông?]() Phân tích - Dự báo

Phân tích - Dự báo

Thế giới thiệt hại dầu mỏ như thế nào sau 50 ngày xung đột Trung Đông?

13:49' - 21/04/2026

Thế giới đã mất hơn 50 tỷ USD (64 tỷ đô la Singapore) dầu thô do không được sản xuất kể từ khi xung đột Trung Đông bắt đầu cách đây 50 ngày.

-

![Kinh tế toàn cầu đối mặt nguy cơ đình lạm]() Phân tích - Dự báo

Phân tích - Dự báo

Kinh tế toàn cầu đối mặt nguy cơ đình lạm

07:38' - 20/04/2026

Theo chuyên gia, tác động cộng dồn của bảy tuần xung đột tại khu vực Trung Đông sẽ bắt đầu lộ diện rõ hơn trong tuần này, thông qua kết quả khảo sát hoạt động kinh doanh đợt hai từ nhiều quốc gia.

-

![ADB: Đồng yen có thể chịu thêm sức ép]() Phân tích - Dự báo

Phân tích - Dự báo

ADB: Đồng yen có thể chịu thêm sức ép

15:59' - 19/04/2026

Chủ tịch ADB Masato Kanda cảnh báo yen có thể suy yếu do chênh lệch lãi suất và lo ngại tài khóa, trong bối cảnh BoJ duy trì chính sách nới lỏng.

-

![Thị trường năng lượng bất ngờ xoay trục sang nhiên liệu sinh học]() Phân tích - Dự báo

Phân tích - Dự báo

Thị trường năng lượng bất ngờ xoay trục sang nhiên liệu sinh học

15:12' - 18/04/2026

Những biến động khó lường liên quan đến xung đột quân sự và nguy cơ gián đoạn nguồn cung dầu tại Trung Đông đang tạo ra một chuyển động hiếm thấy trên thị trường năng lượng toàn cầu.

-

![Xu hướng mới trong quan hệ Việt Nam - Trung Quốc]() Phân tích - Dự báo

Phân tích - Dự báo

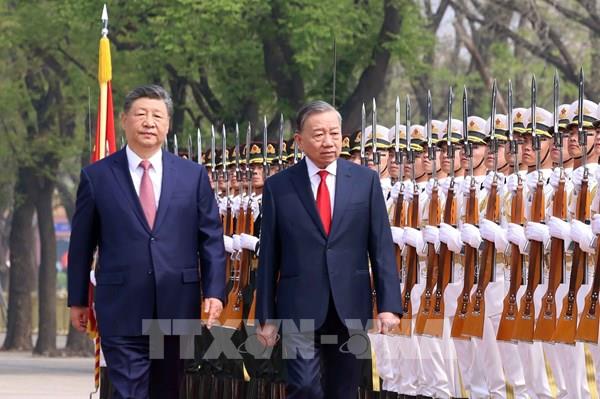

Xu hướng mới trong quan hệ Việt Nam - Trung Quốc

16:02' - 17/04/2026

Hàng chục văn kiện hợp tác đã được ký kết, bao gồm các lĩnh vực như quan hệ kênh Đảng, công an, tư pháp, kinh tế, hợp tác chuỗi cung ứng, hợp tác hải quan, khoa học và công nghệ.

-

![IMF cảnh báo tăng trưởng toàn cầu chậm lại và lạm phát tăng cao]() Phân tích - Dự báo

Phân tích - Dự báo

IMF cảnh báo tăng trưởng toàn cầu chậm lại và lạm phát tăng cao

11:24' - 07/04/2026

Cuộc xung đột ở Trung Đông đang dẫn đến lạm phát cao hơn và tăng trưởng kinh tế toàn cầu chậm lại.

-

![Việt Nam - Điểm sáng trong bức tranh khủng hoảng mới]() Phân tích - Dự báo

Phân tích - Dự báo

Việt Nam - Điểm sáng trong bức tranh khủng hoảng mới

18:20' - 03/04/2026

Việt Nam nổi lên như một “điểm sáng” khi “tiêu thụ” lượng lớn lao động trẻ nhờ sản xuất xuất khẩu và hội nhập chuỗi cung ứng.

Nghị viện châu Âu đã thông qua Đạo luật Trí tuệ Nhân tạo mới. Ảnh minh họa: TTXVN

Nghị viện châu Âu đã thông qua Đạo luật Trí tuệ Nhân tạo mới. Ảnh minh họa: TTXVN